Ce qui rend Wan 2.2 différent de Wan 2.1

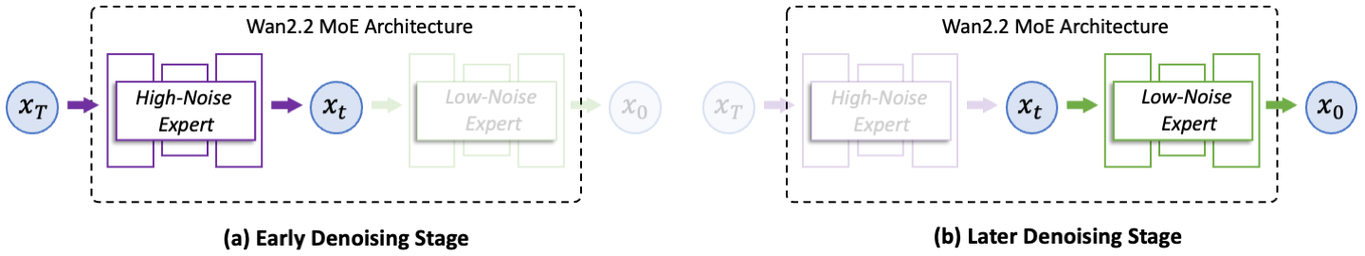

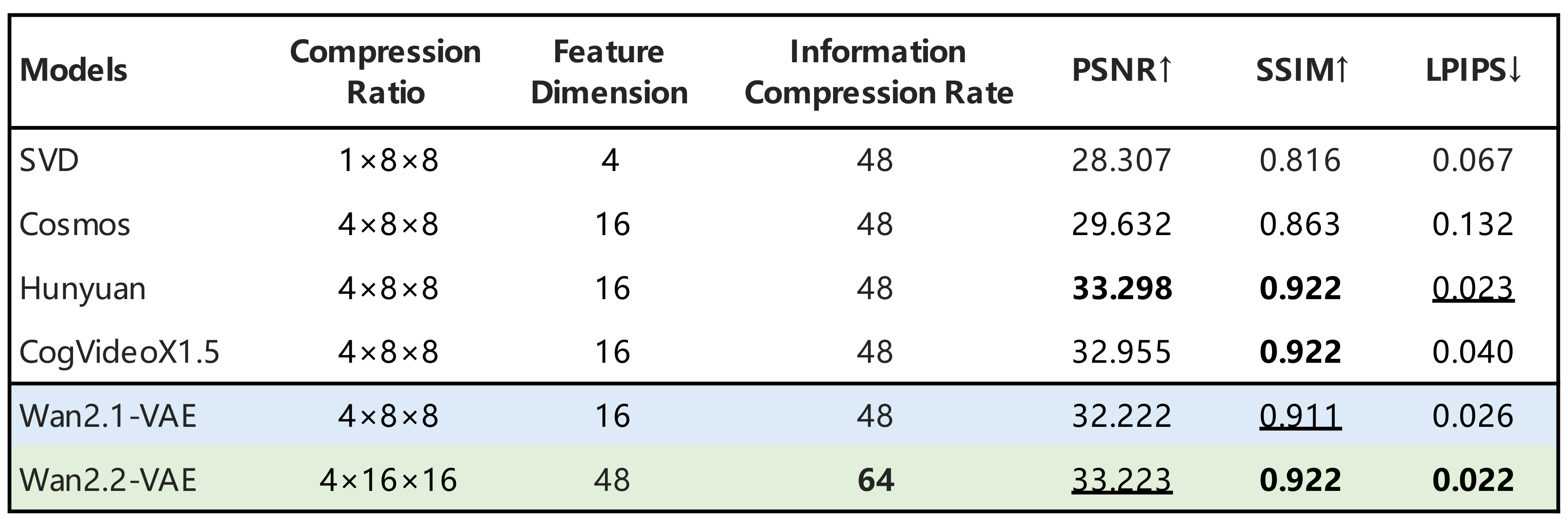

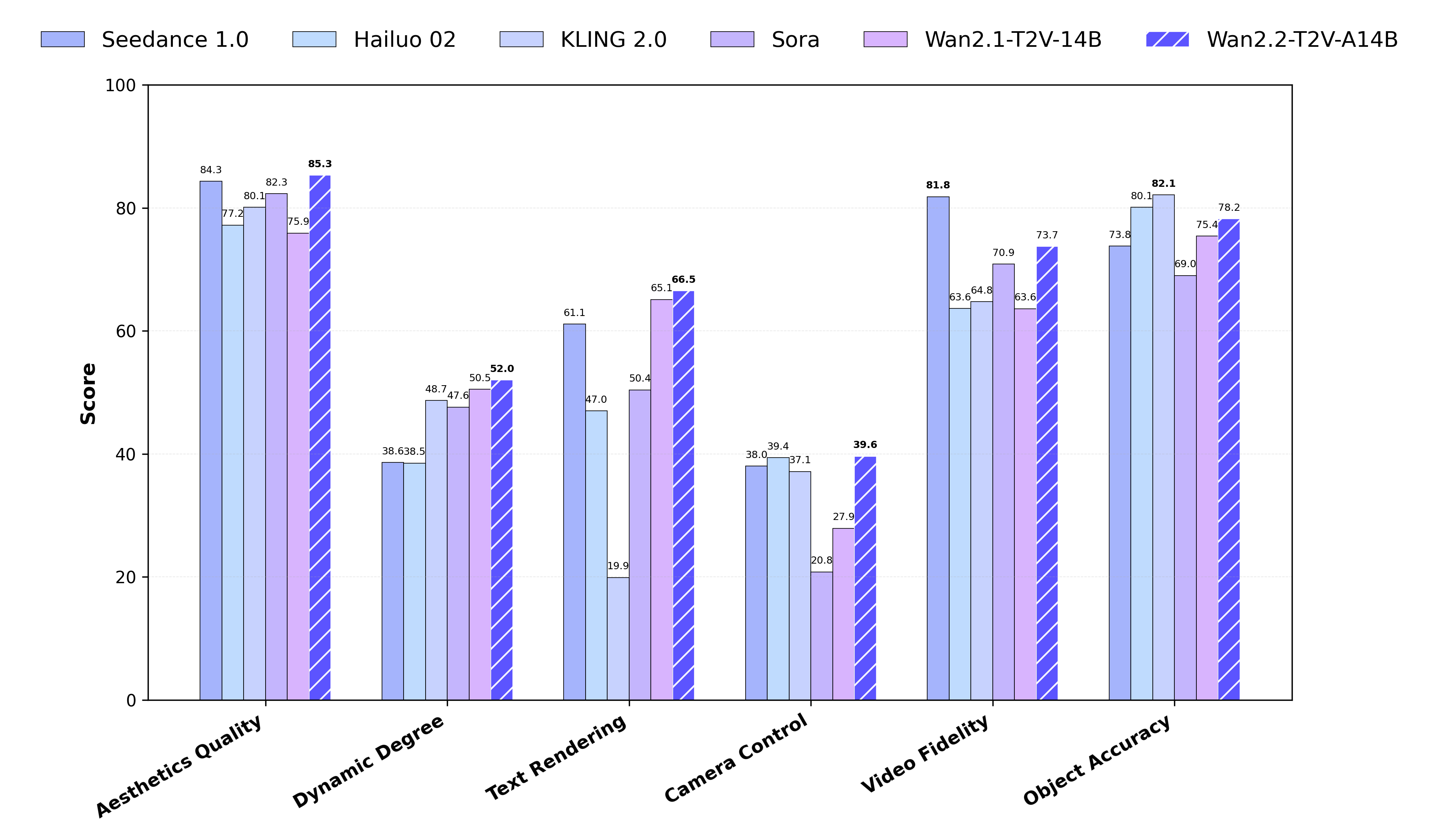

Wan 2.2 est un générateur vidéo par IA de nouvelle génération développé par Wan AI, une équipe de recherche affiliée à Alibaba. Conçu pour les tâches de génération vidéo à partir de texte et d’image, il produit des vidéos cinématographiques de haute qualité, rapides et avec des mouvements réalistes. Par rapport à Wan 2.1, cette version présente une architecture puissante de type Mixture of Experts (MoE), permettant une génération plus fluide, une meilleure adhérence aux prompts et un contrôle visuel renforcé.